Terkejut sekaligus mengerikan. Setidaknya itu yang saya rasakan ketika membimbing GPT-2 dalam menyelesaikan sebuah teks. Dari jumlah kecil data yang dikumpulkan. GPT-2 dapat menyusun sebuah teks yang anak kuliah saja tidak akan bisa buat.

GPT-2 adalah artificial intelligence (AI) yang disusun dari 1,3 miliar teks di internet. Digagas oleh Adam King, seorang engineer machine learning, GPT-2 juga disebut Talk To Transformer. GPT-2 akan menciptakan teks baru untuk merespon teks yang diinput manasuka (arbitrer).

Teks yang dikumpulkan, kemudian dimodifikasi oleh algoritma machine-learning. Sehingga GPT-2 akan menyusun lanjutan dari teks yang kita berikan. Lebih mengejutkan. Dari mulai grammar sampai koherensi begitu tepat. Bagi penikmat kesusastraan, bahkan tone dan mood dari teks hasil pun bisa disesuaikan.

Di bawah ini adalah contoh teks yang dilengkapi oleh GPT-2. Dengan kalimat awal adalah panduan (prompt) yang saya berikan.

Contoh 1 dari GPT-2 dengan teks panduan saya di awal paragraf.

Kalimat awal yang saya berikan memang berkesan horor. Dan GPT-2 dapat menciptakan teks lanjutan yang masih dalam

tone dan

mood horor. Teks di atas diciptakan (generate) dengan satu kali klik.

Namun, tidak semua teks bisa diciptakan sekali klik. Di contoh lain dengan didapat beragam hasil. Seperti contoh-contoh di bawah ini:

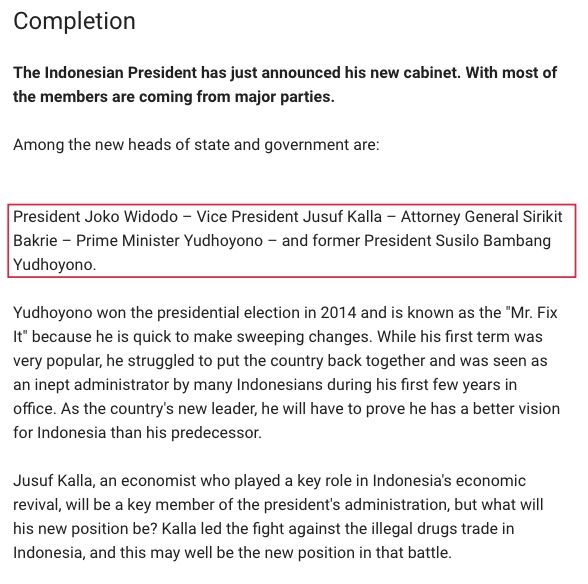

Contoh 2 dari GPT-2 dengan teks panduan saya di awal paragraf.

Di atas adalah hasil setelah saya meng-klik

generate 3 kali. Pada kotak merah, terdapat banyak kerancuan. Antara lain, ada nama

Attorney General (Hakim Agung) bernama Sirikit Bakrie. Sedang jika kita telusur, agak asing di telinga kita nama Sirikit. Namun tidak dengan Bakrie. Sedang kedua paragraf setelah cukup koheren dengan kalimat awal yang saya buat.

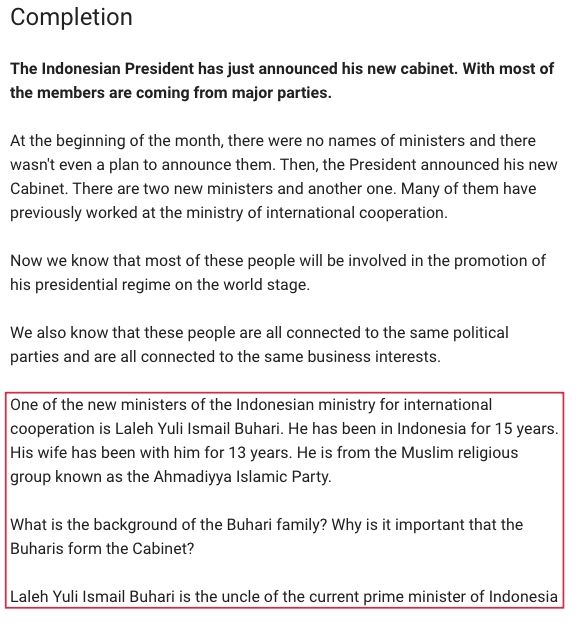

Contoh 3 dari GPT-2 dengan teks panduan saya di awal paragraf.

Di atas adalah hasil 4 kali klik

generate text. Bentuknya lebih seperti opini dengan mood yang cukup akademis. Ketiga paragraf setelah kalimat panduan dari saya cukup bernas menyampaikan opini. Namun di kalimat yang saya kotaki merah. GPT-2 nampaknya memasukkan data yang cukup aneh. Ada nama Melayu (

Buharis) dan Partai Ahmadiyah (

Ahmadiyya). Padahal ke dua entitas tersebut tidak ada di Indonesia.

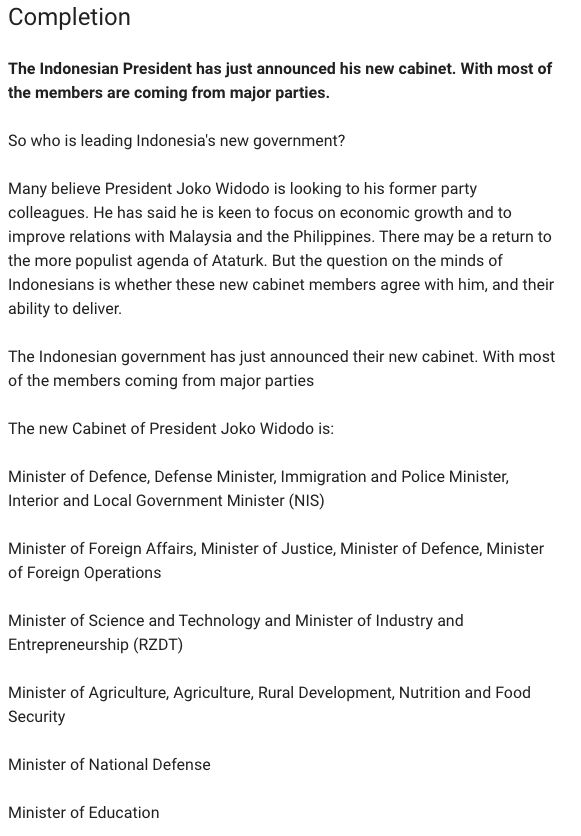

Contoh 4 dari GPT-2 dengan teks panduan saya di awal paragraf.

Dan setelah hampir 7 kali mengklik tombol generate. Teks inilah yang saya rasa cukup baik. Konteks kekinian dan

tone politik begitu terasa. Walau ada kalimat tentang Ataturk (paragraf 1). Namun hal ini bisa dihilangkan. Sekaligus menambahkan nama-nama Menteri yang kiranya nanti benar-benar ditunjuk Presiden Joko Widodo di kabinet 2019-2024.

Akan mengerikan jika seseorang yang melihat GPT-2 sebagai sumber referensi tulisan. Dan bisa jadi menjadi sumber plagiasi. Membuat tugas esai tak lagi sulit dibuat. Apalagi mesin pencari akan sulit menemukan teks serupa yang dibuat oleh GPT-2.

Narasi fiktif mengenai berita aktual tapi dibuat sensasional bukan tidak mungkin dapat dibuat. Opini yang dibuat GPT-2 (Contoh 3) saya pribadi pikir cukup logis. Walau nanti bisa disalahgunakan pihak pencari clickbait atau sekadar car sensasi.

Lihat Gadget Selengkapnya