Di bagian sebelumnya, saya sudah membahas tentang pemisahan karakter yang dilakukan di Photoshop. Dan sekarang waktunya bikin karakternya gerak-gerak di Live2D!

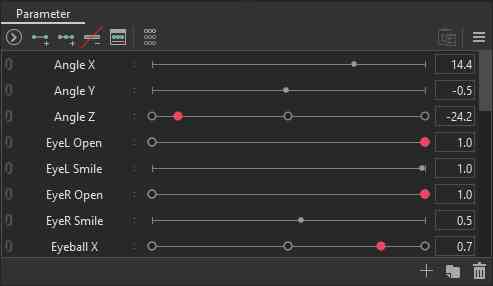

Seperti yang pernah saya jelasin di artikel yang berjudul "Wayang Digital", Live2D cara kerjanya adalah dengan beberapa parameter atau yang saya suka sebut "slider".

Parameter-parameter ini bisa diistalahkan sebagai "keyframe", ada yang punya 3 point (misalnya Eyeball X. Yaitu kiri, tengah, kanan untuk menggerakan mata secara horizontal.) dan ada yang hanya punya 2 point (misalnya EyeL/R Open. Yaitu tutup dan buka untuk mata) (sekedar info, point di parameter bisa lebih dari 3. Tapi umumnya 3 paling banyak).

Cara kerjanya adalah dengan mengatur objek ke semua point dari parameter yang kita perlu. Contohnya, layer kelopak mata diatur oleh parameter "EyeL/R Open" dan parameter tersebut mempunyai 2 titik. Pilih titik pertama (tutup) dan ubah layer agar mata terlihat tertutup, kalau untuk titik kedua tidak perlu karena dari gambar memang sudah terbuka.

Kalau terdengar membingungkan, memang menurut saya ini juga agak sedikit membingungkan. Tapi hasilnya jadi seperti gambar di atas, ketika parameter "EyeL Open" jadi 0,0 mata akan tertutup dan jika parameter tersebut jadi 1,0 mata akan terbuka.

Masing-masing bagian harus di atur ke parameternya masing-masing. Misalnya mata kiri ke "EyeL Open (Kelopak), Eye X (Iris), Eye Y (Iris), dsb", bulu mata ke "Eyebrow Angle, Eyebrow Y, dsb" dan masih banyak lagi contohnya.

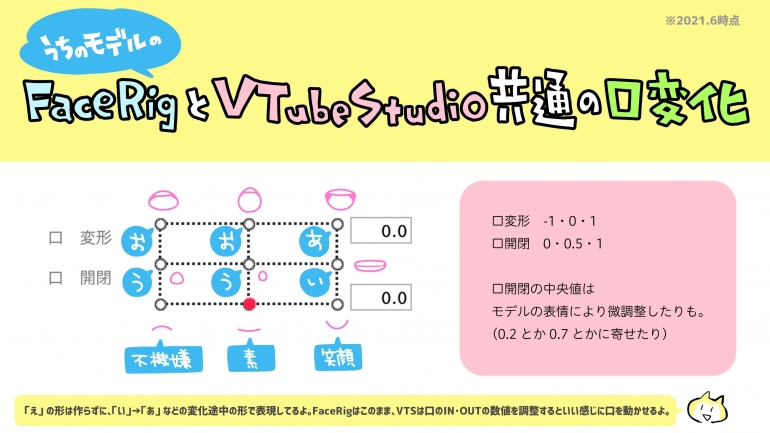

Bukan diary namanya kalau saya gak menceritakan kesulitan saya, kesulitan saya ada di mulut. Mulut dibagi jadi 3 layer (Atas, bawah, dalam), saya sendiri bingung gimana cara bentuknya? Ada parameter "Mouth Form" dan "Mouth Open", "Mouth Open" sendiri bisa ditebak lah artinya, tapi "Mouth Form" itu apa?

Setelah mencari beberapa tutorial di YouTube, ternyata ada metodenya sendiri untuk membuat mulut. Saya ketemu cara 3x3 (karena pointnya ada 9)

dan dijelaskan apa itu masing-masing parameternya, ternyata Mouth Form ada 3 point (sedih, netral, senang). Begitu lihat tutorial sedikit, saya pikir lagi: "Ah inimah gampang, tinggal buka mulutnya, tekuk dikit sampe kelihatan sedih" ternyata ada referensi yang harus diikuti

Kira-kira 1 jam setengah saya habisin cuma buat bikin mulut doang.

Setelah mulut selesai. Saya seneng "Yey, modelnya udah selesai" saya pikir, ternyata lupa untuk mengatur parameter "EyeL/R Open" yang di deket-deket bagian awal saya bahas. Singkatnya, setelah melihat referensi (Mark-kun) dan beberapa tutorial, saya mengerti bagaimana cara membagi-bagi matanya dan bagaimana cara menggerakannya.

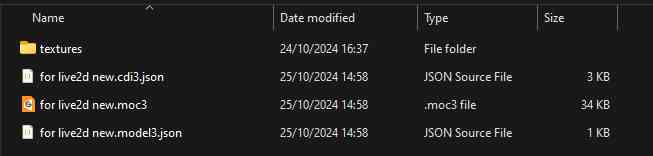

Semuanya selesai, tinggal masukkin ke program face tracking. Ternyata Live2D sendiri menyediakan program yang bernama nizima Live untuk face tracking. Saya kira tinggal save terus masukkin, ternyata saya salah. Setelah lihat tutorial lagi akhirnya saya ngerti bahwa ternyata harus di "Export".

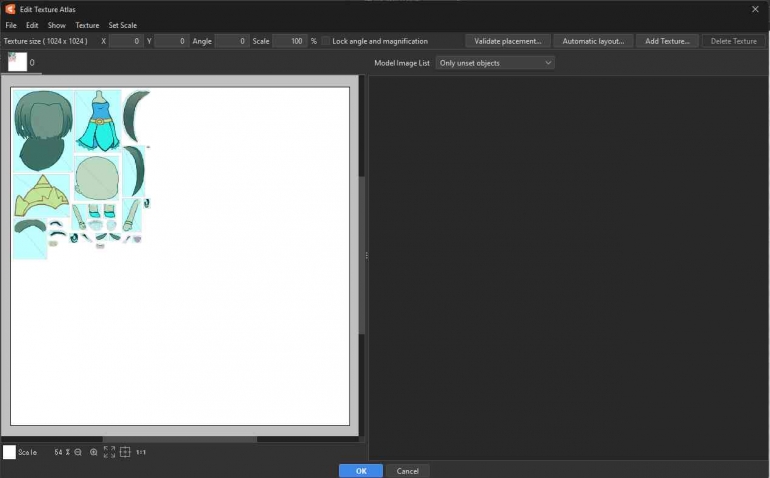

Pas mau export ada error: "Invoke after texture atlas is generated", ternyata perlu bikin texture atlas dulu. Untungnya, gampang buat bikin texture atlas, tinggal ke windownya terus "Generate texture atlas". Akhirnya saya bisa export!

Hasilnya saya masukkan ke software nizima Live sehingga bisa tracking muka saya agar modelnya mengikuti. Hasilnya bisa dilihat sendiri pada video di bawah.

Sekian dulu dari artikel saya. Mungkin bakal ada part selanjutnya atau mungkin ini part terakhir (saya juga agak bingung). Kalau kalian ada masukkan atau opini, silahkan komentar di bawah ya!

Follow Instagram @kompasianacom juga Tiktok @kompasiana biar nggak ketinggalan event seru komunitas dan tips dapat cuan dari Kompasiana. Baca juga cerita inspiratif langsung dari smartphone kamu dengan bergabung di WhatsApp Channel Kompasiana di SINI