Kalian pasti pernah denger yang namanya "VTuber" kan? VTuber adalah singkatan dari Virtual Youtuber, tapi kalau kita lihat-lihat sekarang VTuber juga sudah ada di platform-platform media sosial lain seperti Instagram, TikTok, dan lain hal sebagainya. VTuber sendiri sudah ada dari kira-kira pertengahan tahun 2010, tapi mulai populer pada masa-masa pandemi Covid-19 dengan beberapa agensi seperti Hololive, Nijisanji, VShojo, dan lain sebagainya.

"Kok bisa sih avatarnya ngikutin orangnya kalau gerak kiri kanan?" Ini yang pernah saya pikirkan, akhirnya saya mencari informasi tentang hal ini dan menemukan teknologi Live2D. Teknologi ini memungkin sebuah karakter / avatar 2 dimensi bergerak baik mata, mulut, bahkan kepala.

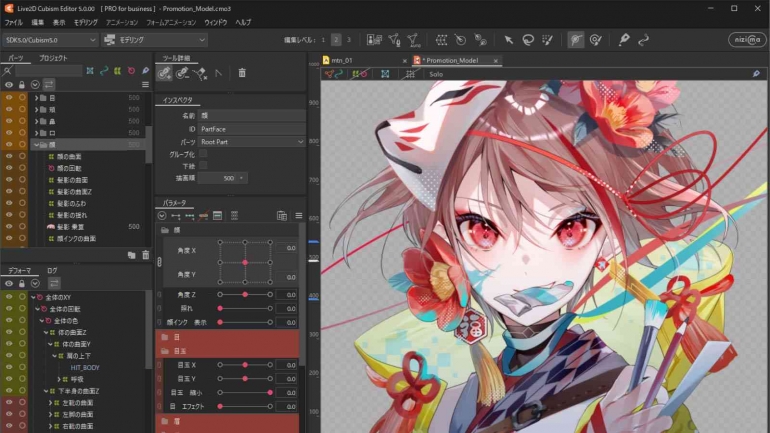

"Wah gampang dong bikin model sendiri? tinggal ambil dari google terus masukkin Live2D?" Saya sempat mengira seperti itu, tapi tidak semudah itu untuk membuat sebuah model VTuber. Seperti gambar di atas, untuk membuat sebuah model VTuber perlu dipisah bagian-bagiannya dan cara memisahkannya juga tidak mudah, kalau kalian lihat pada gambar di atas ternyata perlu juga menggambar bagian yang tidak terlihat (tertutup) contohnya muka yang tertutup oleh rambut tetap harus lengkap saat dipisah. Pemisahannya sendiri menggunakan program Photoshop.

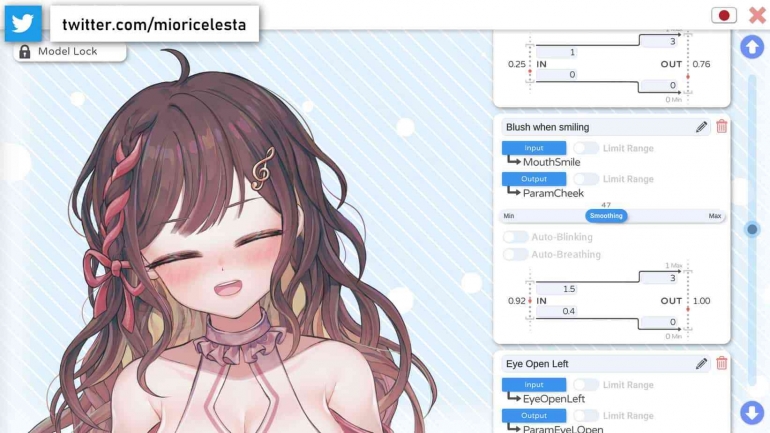

"Udah dipisahin tinggal masukkin ke Live2d terus langung jadi VTuber dong?" Oh, tidak secepat itu. Setelah gambar sudah dipisah-pisah, di dalam Live2D harus digerakkan sesuai dengan slider. Contohnya slider "Eyeball X" mempunyai jangkauan dari -1 hingga 1, -1 berarti mata ke kiri dan 1 mata ke kanan, atur slider ke -1 dan gerakkan kedua bola mata ke kiri, setelah itu bisa di mirror ke kanan. Proses ini dinamakan rigging dan harus dilakukan satu-persatu untuk tiap slider.

"Udah dipisah-pisah, udah di rig. Terus apa?" Setelah itu, model dari Live2D tersebut perlu dimasukkan ke dalam software yang bisa melihat wajah kita dan mengubahnya ke dalam value dalam slider tersebut, untungnya ada banyak program yang bisa melakukan ini tapi ada satu yang paling populer yaitu VTube Studio. Untuk face tracking ada yang memakai webcam, walaupun metode ini cukup mudah dan tidak mahal, metode ini agak berat untuk dijalankan dan kadang hasilnya gak akurat dan bisa juga memakai ARKit yang ada di iPhone, metode ini menggunakan teknologi face tracking dari Apple dan biasanya lebih akurat karena sensornya ada banyak, tapi sayangnya untuk metode ini sendiri perlu menggunakan iPhone sehingga agak mahal.

"Repot banget, mau beli aja ah. Kira-kira harganya berapa?" Nah ini, harga dari sebuah model VTuber itu gak menentu karena tergantung dengan kualitas, saya pernah lihat ada model VTuber yang seharga $2000 dan ada juga yang $500. Jadi tergantung budget dan juga kualitas. Ada juga model VTuber yang 3 dimensi, tapi mungkin saya akan bahas pada artikel lainnya.